Gefälschte Pornos

Deepfake-Recherche: Moderatorin findet sich selbst

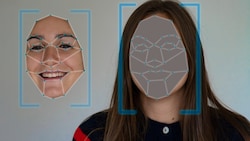

Sogenannte Deepfakes, bei denen Gesichter meist prominenter Personen in explizite Videoaufnahmen geschnitten werden, erleben nicht zuletzt seit der Verbreitung von Künstlicher Intelligenz einen bedenklichen Trend. Eine britische Reporterin wollte dazu nun einen Beitrag recherchieren – und fand sich prompt selbst als Opfer.

Eigentlich sei sie es aufgrund ihrer Arbeit gewöhnt, verstörendes Videomaterial zu sehen, berichtete die investigative Journalistin Cathy Newman in der „Times“. „Es war unbestreitbar mein Gesicht, aber es war fachkundig auf den nackten Körper einer anderen gelegt worden“, schilderte sie ihre Entdeckung.

Newman „völlig entmenschlicht“

Das von ihr entdeckte Video sei jedoch „eine groteske Parodie“ gewesen – so wurde etwa auch ihre charakteristisch lockige Frisur durch glattes Haar ersetzt. Sie habe sich durch das Video „völlig entmenschlicht“ gefühlt, zeigte sie sich schockiert, wie der nach wie vor unbekannte Täter sie mit leicht verfügbarer Technologie „zu einer Reihe sexueller Aktivitäten zu zwingen“ konnte.

Eigentlich hatten Newman und ihr Team gar nicht sich selbst im Fokus der Recherchen gesehen – sie wollten zunächst anhand von prominenten Beispielen, wie Taylor Swift, Giorgia Meloni, Jenna Ortega oder Alexandria Ocasio-Cortez die Problematik der gefälschten Videos aufzeigen. Allein die gefälschten Videos von Swift wurden mittlerweile mehr als 45 Millionen Mal online abgerufen, schreiben die Journalisten in ihrem Bericht – die fünf beliebtesten Pornoseiten, die sich auf Deepfakes spezialisiert haben, kommen demnach auf fast 100 Millionen Aufrufe in nur drei Monaten.

Problematik Deepfake-Pornos:

Deepfake-Pornos stellen eine ernsthafte Bedrohung für die Privatsphäre und den Ruf der betroffenen Personen dar, da sie mithilfe von KI-Technologien täuschend echte, aber gefälschte Videos erstellen können, die Personen in pornografischen Szenen zeigen, ohne deren Zustimmung. Diese Technologie ermöglicht es auch, falsche Erzählungen zu verbreiten und das Vertrauen in Medien zu untergraben.

Erklärung für seltsamen Frisurenwandel

Dem Problem ist schwer Herr zu werden, auch wenn die Politik es zumindest in Ansätzen bereits versucht. Erst Ende März etwa leitete die EU-Kommission den Kampf gegen politische Falschinformationen und Deepfakes ein und veröffentlichte entsprechende Leitlinien dazu. In Großbritannien droht den Herstellern von Deepfakes künftig auch eine strafrechtliche Verfolgung.

Für Newman ist das jedoch nicht genug: „Gesetzgeber auf der ganzen Welt hinken der Technologie und den Tätern, die sie zum Missbrauch von Frauen nutzen wollen, weit hinterher“, forderte sie mehr Engagement. Den seltsamen Frisurenwandel in ihrem Video konnte sie bei ihren Recherchen aufklären – offenbar hat die eingesetzte KI nämlich noch „mit Locken zu kämpfen“.

Kommentare

Willkommen in unserer Community! Eingehende Beiträge werden geprüft und anschließend veröffentlicht. Bitte achten Sie auf Einhaltung unserer Netiquette und AGB. Für ausführliche Diskussionen steht Ihnen ebenso das krone.at-Forum zur Verfügung. Hier können Sie das Community-Team via unserer Melde- und Abhilfestelle kontaktieren.

User-Beiträge geben nicht notwendigerweise die Meinung des Betreibers/der Redaktion bzw. von Krone Multimedia (KMM) wieder. In diesem Sinne distanziert sich die Redaktion/der Betreiber von den Inhalten in diesem Diskussionsforum. KMM behält sich insbesondere vor, gegen geltendes Recht verstoßende, den guten Sitten oder der Netiquette widersprechende bzw. dem Ansehen von KMM zuwiderlaufende Beiträge zu löschen, diesbezüglichen Schadenersatz gegenüber dem betreffenden User geltend zu machen, die Nutzer-Daten zu Zwecken der Rechtsverfolgung zu verwenden und strafrechtlich relevante Beiträge zur Anzeige zu bringen (siehe auch AGB). Hier können Sie das Community-Team via unserer Melde- und Abhilfestelle kontaktieren.